-

LCM-LoRA : A Universal Stable-Diffusion Acceleration Module 테크 리포트 리뷰논문 후기와 구현 2024. 11. 1. 15:45728x90

논문은 아니고 간단한 테크 리포트이다.

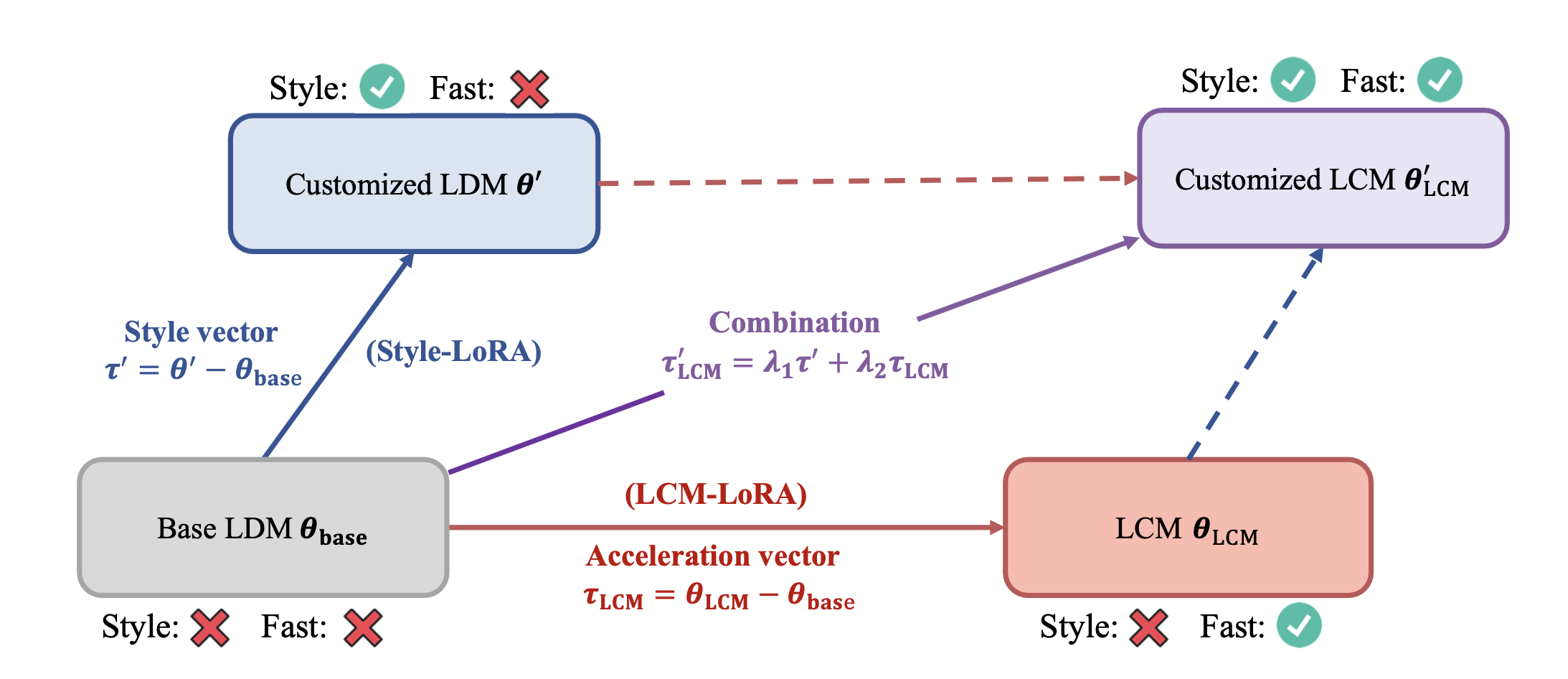

결론 : LCM과 LoRA를 함께 쓰는 게 가능하다.

- Latent Diffusion Models (Diffusion 과정을 latent space에서 진행하는 것)은 뛰어난 성능을 보였지만, 실시간성에 문제가 있다. 매우 느리기 때문이다.

- DDIM, DPM-Solver 등의 ODE-Solver들이 아주 우수하지만, 여전히 연산 부하가 크고, 여러 distillation 방법이 있지만, 계산 비용이 엄청 높다.

- LCM은 1000에 이르던 step 수를 1-4로 낮추었다. 또한 단 32 A100 시간 내에 distillation이 가능하다.

- 한편, LoRA는 fine-tuning에 필요한 weight matrix의 rank를 낮추기 때문에, 결과적으로 파라미터 수를 줄여서 메모리 사용량을 줄인다.

- LCM과 LoRA는 결합이 가능하다. SD-V1.5, SSD-1B, SDXL 등 다양한 모델에 추가 학습 없이 바로 연결할 수 있다

- LCM-LoRA는 여러 이미지 생성 작업에 적용할 수 있는 범용 PF-ODE Solver로 작동한다. 모델이 특정 스타일에 맞게 학습된 LoRA와 결합하면, 새로운 학습 없이도 원하는 스타일의 이미지를 빠르게 생성할 수 있다.

- 실험 결과, LCM-LoRA는 기촌 numerical한 PF-ODE보다 sampling 속도가 빠르고 메모리 사용량이 적었다.

'논문 후기와 구현' 카테고리의 다른 글